新闻中心

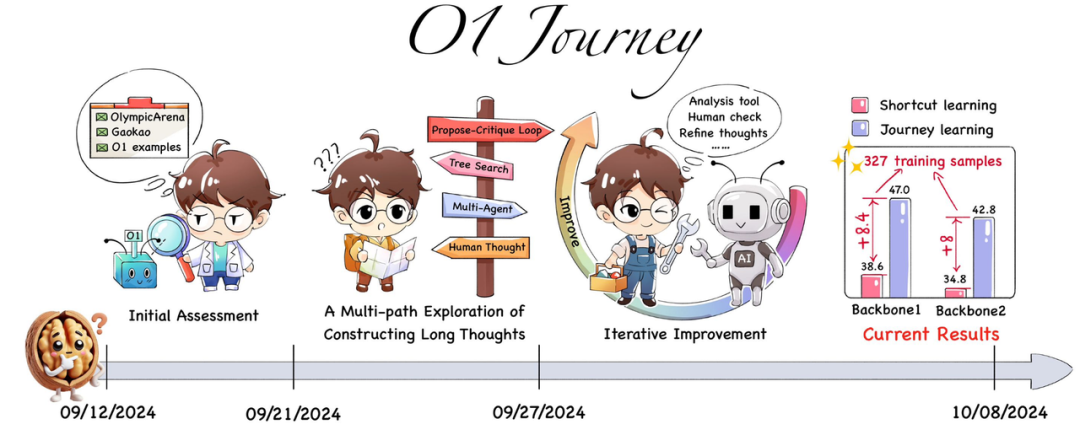

上交大发布首个OpenAI o1复现项目进展报告,满满的经验洞察

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

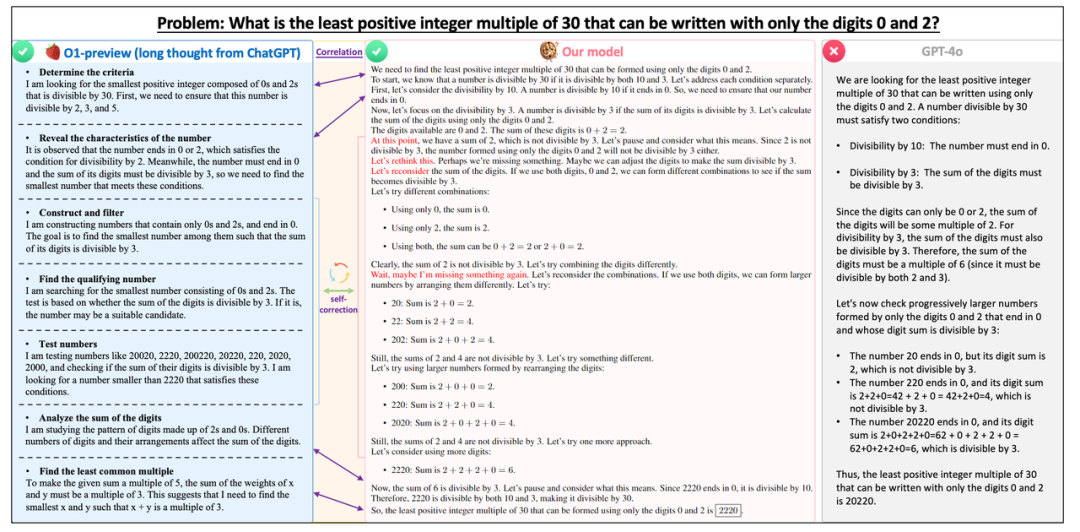

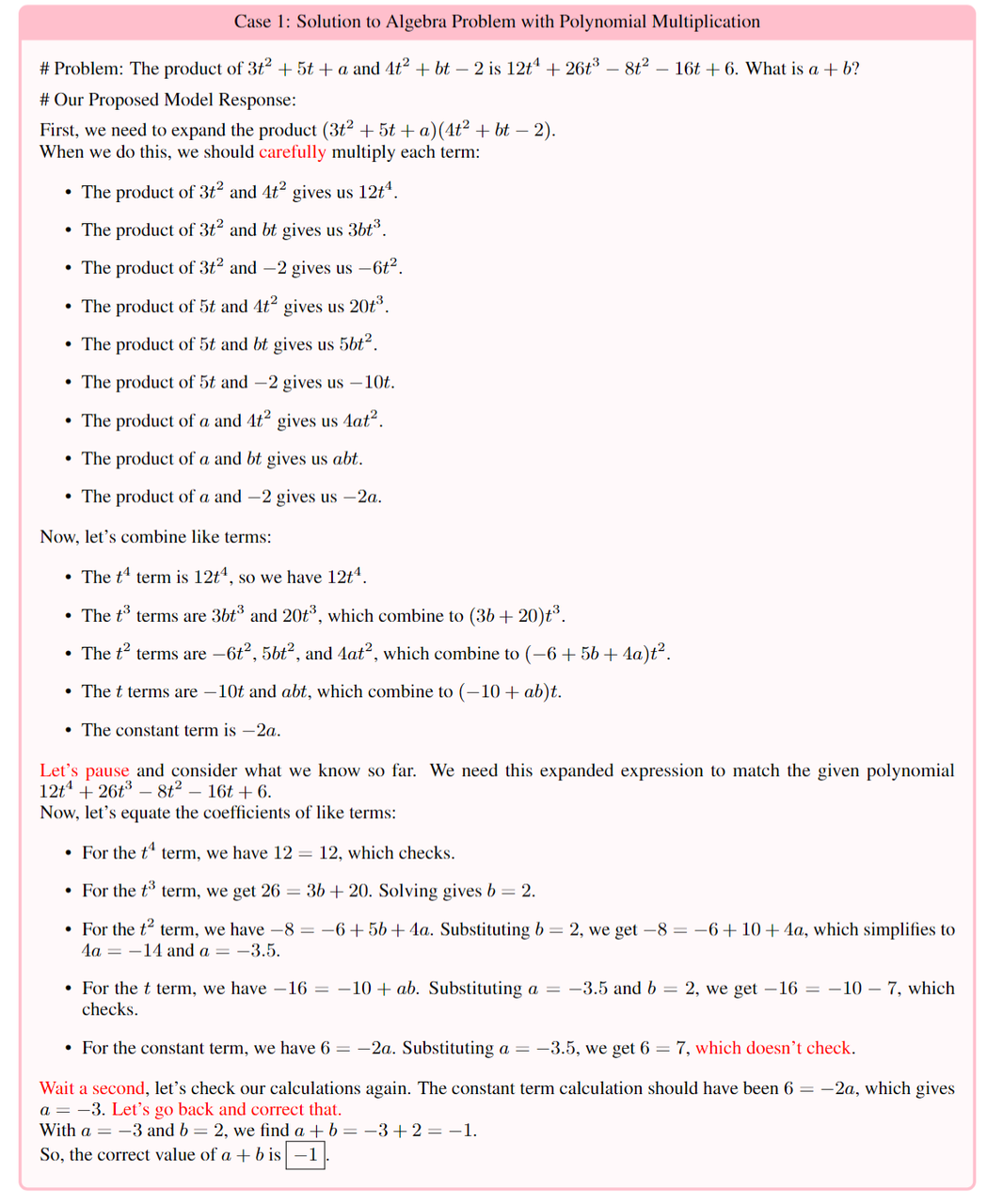

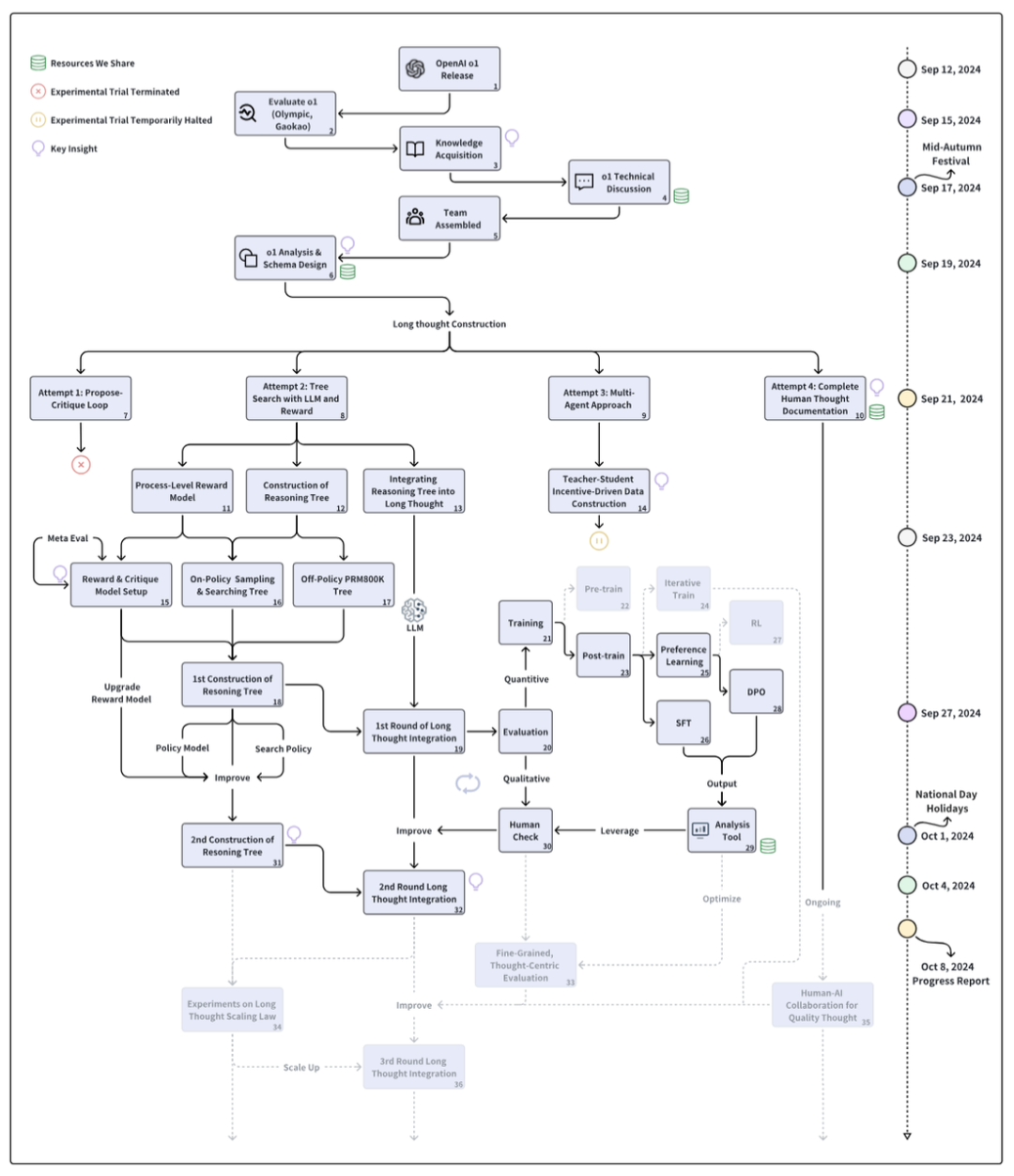

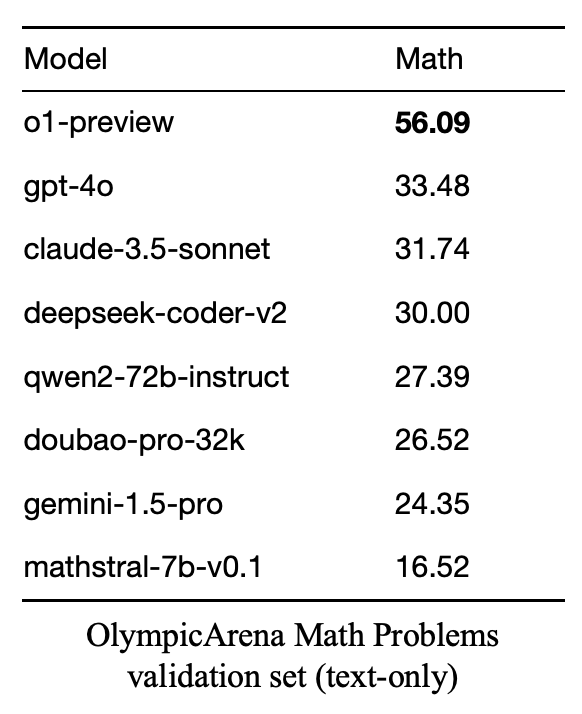

团队提出的模型在同一道数学题上,与 OpenAI 的 o1-preview (答对)及 GPT-4o(答错)的比较实例,证明旅程学习不断试错、反思、自我纠正的能力在复杂推理任务场景上非常关键。

技术报告链接:https://github.com/GAIR-NLP/O1-Journey/blob/main/resource/report.pdf Github 链接:https://github.com/GAIR-NLP/O1-Journey o1 讨论资源:https://gith  ub.com/GAIR-NLP/O1-Journey/tree/main/resource

ub.com/GAIR-NLP/O1-Journey/tree/main/resource

易标AI

易标AI

告别低效手工,迎接AI标书新时代!3分钟智能生成,行业唯一具备查重功能,自动避雷废标项

135

查看详情

135

查看详情

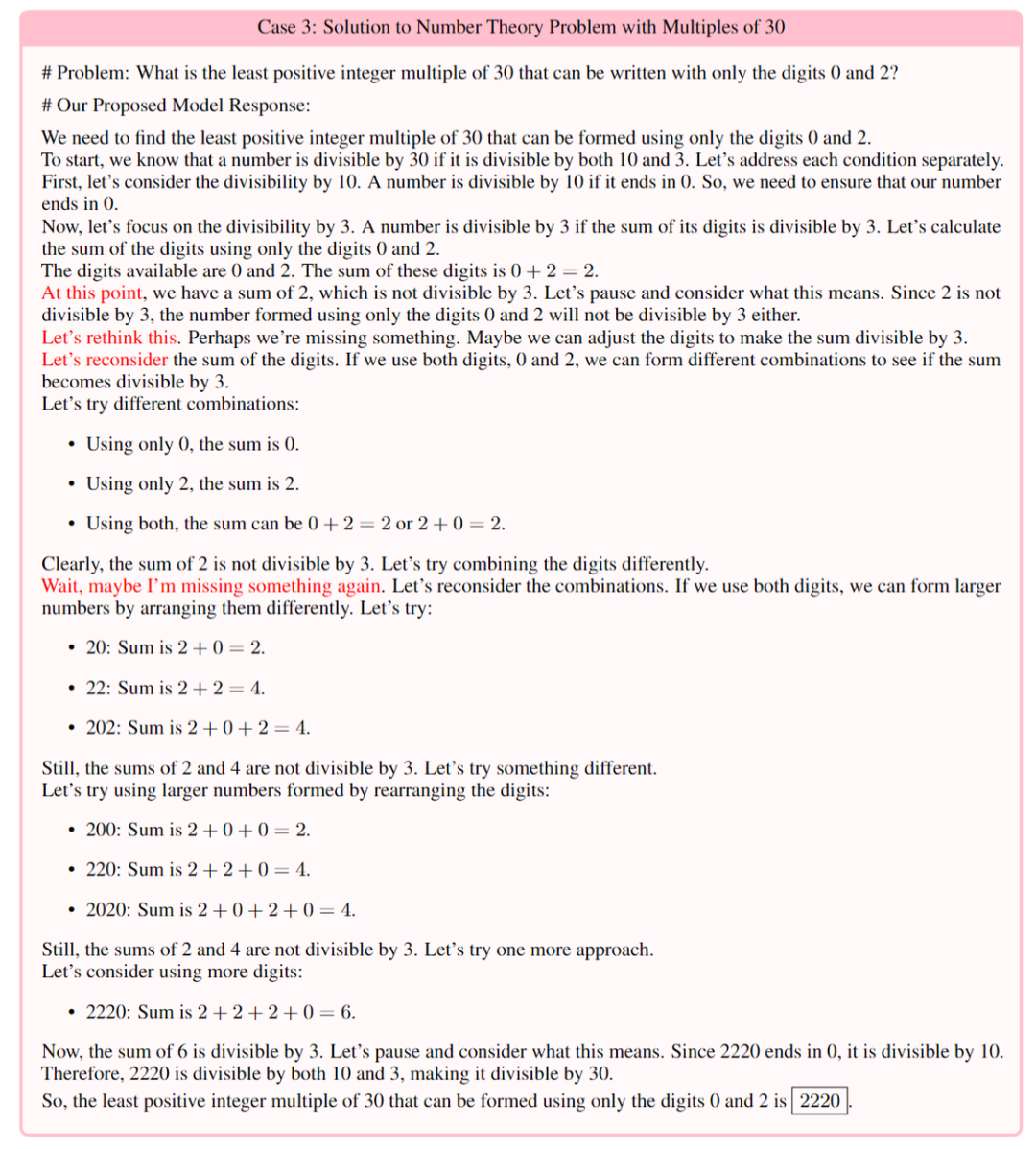

Q1: o1 的思维链是什么样子的? Q2: 长思维 (Long thought) 是如何工作的? Q3: 如何构建长思维? Q4: 如何构建奖励模型? Q5: 如何构建 on-policy 推理树? Q6: 如何从推理树中推导出长思维? Q7: 如何评估我们的尝试方法? Q8: 如何训练我们的模型? Q9: 什么是人类和 AI 协同标注的有效策略?

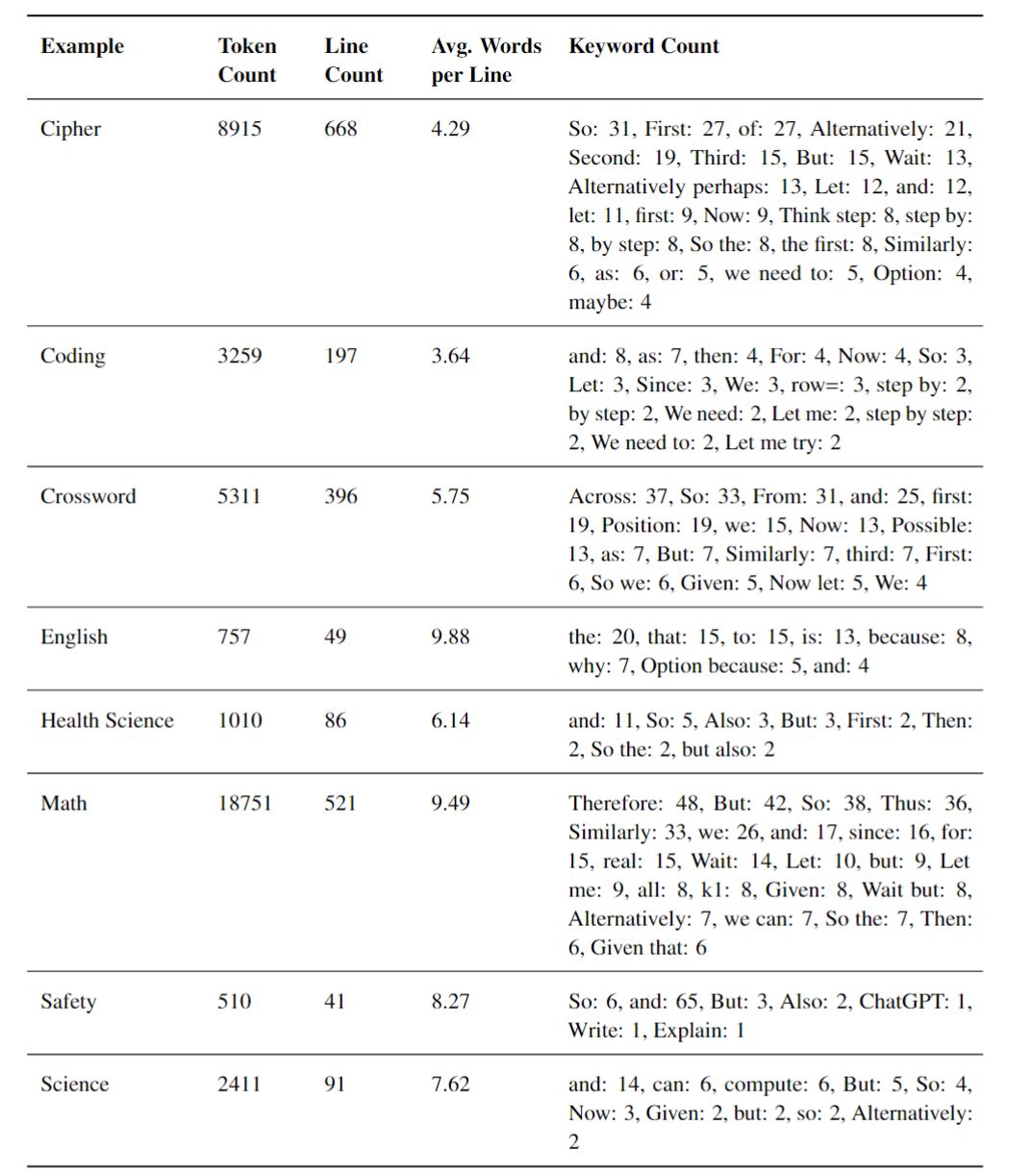

这些示例被分类为不同的问题类型,每种类型都与一个难度级别相关联,从简单的英语阅读理解到复杂的多步骤数学推理任务。分析显示了一个趋势:随着难度的增加,响应长度(包括标记数和行数)往往成比例增长。这表明更高难度的问题涉及更多的推理步骤。 除了标记数和行数外,团队还进行了关键词频率分析,以识别可能表征推理过程的重复出现的术语。除了常见的连接词如 "and" 和 "so" 之外,分析还突出了几个出现频率较低但意义重大的关键词。"consider"、"if" 和 "possible" 等关键词经常出现,通常表示推理过程中的分支,考虑多条路径。这些关键词在复杂度更高的问题中出现频率明显更高,表明模型在这些情况下探索不同的解决方案路径。像 "wait" 和 "Alternatively" 这样的关键词是模型能够进行反思和自我纠正的重要指标。这表明模型具有更深入的理解和更细致的推理方法,因为模型不仅仅是遵循线性路径,还能够基于反思重新考虑和完善其方法。

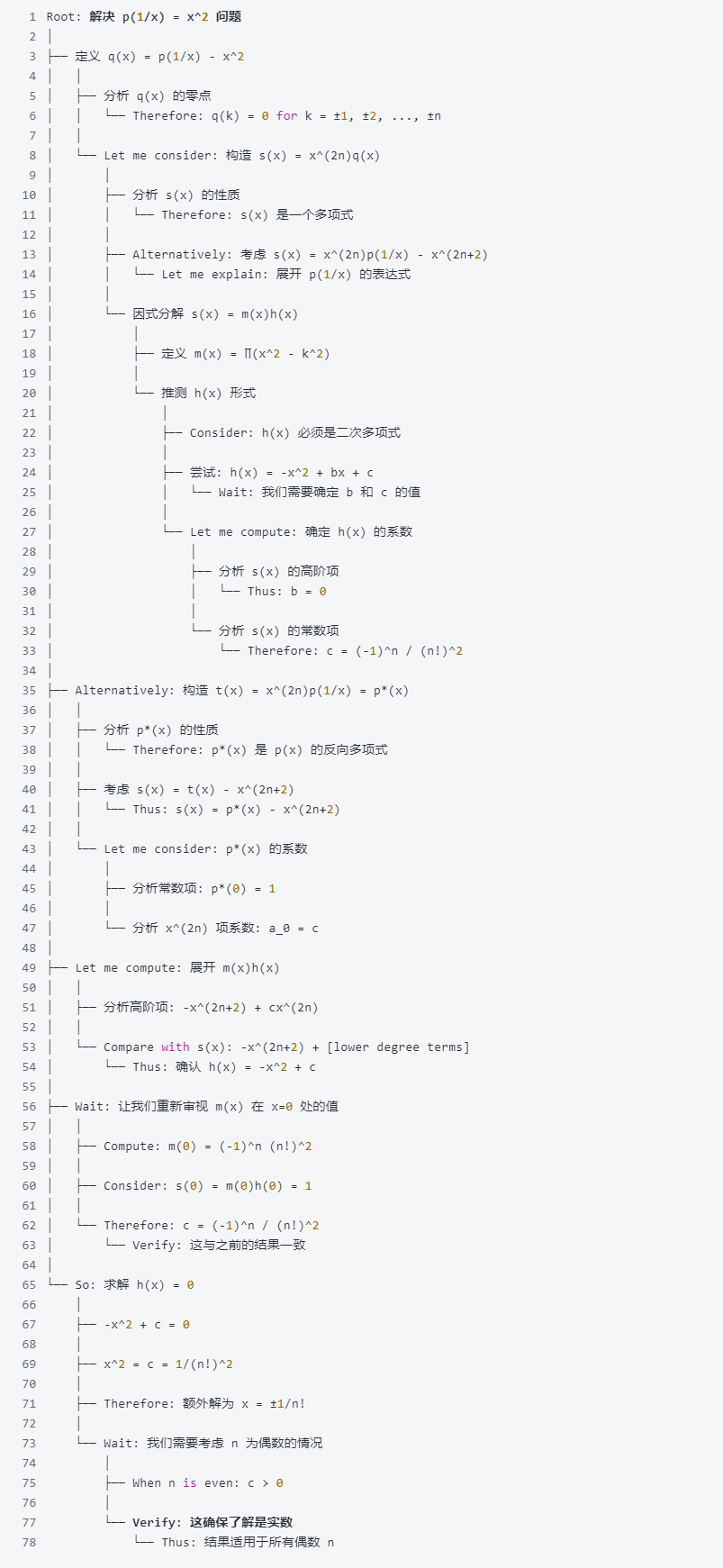

迭代式问题解决:模型首先定义函数,然后逐步探索相关表达式,将复杂方程分解为更简单的组成部分,反映了一种结构化和有条理的方法。 关键思维指标:使用 "Therefore" 表示结论,"Alternatively" 探索不同路径,"Wait" 表示反思,以及 "Let me compute" 过渡到计算,突出了模型的推理阶段。 递归和反思方法:模型经常重新评估和验证中间结果,使用递归结构确保一致性,这在严谨的数学推理中很典型。 假设探索:模型测试不同的假设,随着获得更多信息而调整其方法,展示了推理过程中的灵活性 结论和验证:最后,模型解方程并验证结果,强调在完成之前验证结论的重要性。

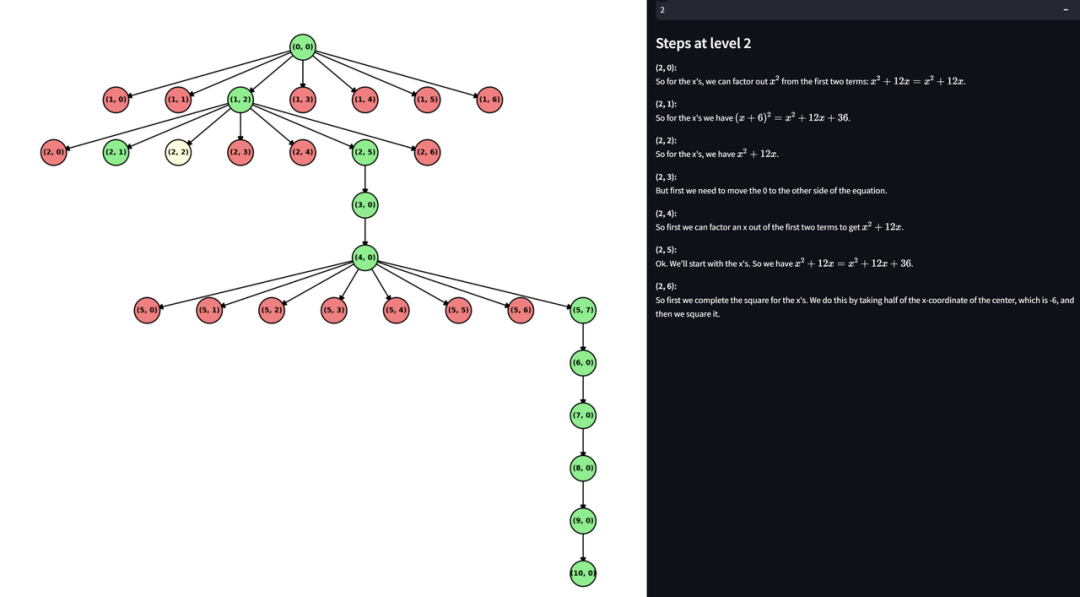

构建推理树需要一个能够执行单步推理的策略模型。给定一个问题及其相应的最终答案,策略模型从问题作为根节点开始,不断向树中添加新节点。它首先生成 w 个可能的第一步推理步骤作为根节点的子节点。然后,它迭代地进行前向推理,为每个当前节点(如第一步推理)生成 w 个可能的后续推理步骤作为该节点的子节点。这个过程重复进行,直到达到预设的最大深度或所有叶节点达到最终答案。

策略模型和步骤分段 构建推理树需要清晰定义推理步骤。为此,团队采用 Abel 提出的数据格式,将数学问题解决方案转化为具有清晰步骤的形式,将答案分成多行,每行以行号开始,并包含该行内的推理。因此,使用 Abel 数据集对 DeepSeekMath-7B-Base 进行微调,得到 Abel-DSMath,作为策略模型。在这种特定格式数据上微调的模型可以方便地控制单个推理步骤的生成。

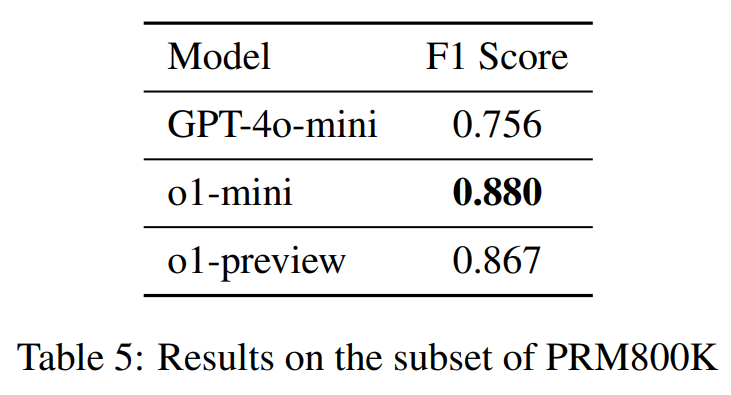

奖励模型和剪枝 上述提出的树生成算法计算成本高昂。当设置后续推理步骤数目为 3 和深度为 10 时,最后一次迭代需要生成 3 的 10 次方个推理步骤。因此,使用奖励模型来剪除错误的推理步骤,提高操作效率。具体来说,团队采用束搜索,在每次迭代中只选择少量候选项保留到下一轮。根据使用的奖励模型,剪枝实现的细节有所不同。团队尝试了两个奖励模型:math-shepherd 和 o1-mini。

Math-shepherd 为每个步骤提供一个介于 0 和 1 之间的实数,表示当前步骤正确的概率。在树生成的每次迭代中,对所有推理步骤进行评分,并选择得分最高的前 K 个进入下一次迭代。这将总生成次数进行剪枝。然而,math-shepherd 在评估困难问题的推理步骤时存在困难,需要一个更强大的奖励模型,能够为每个步骤提供高准确度的正确性指示。因此,最终使用 o1-mini 为每个步骤提供奖励,直接指示每个推理步骤是否正确。此时,在树生成的每次迭代中,利用来自 o1-mini 的奖励,选择最多 K 个正确的推理步骤进入下一次迭代。

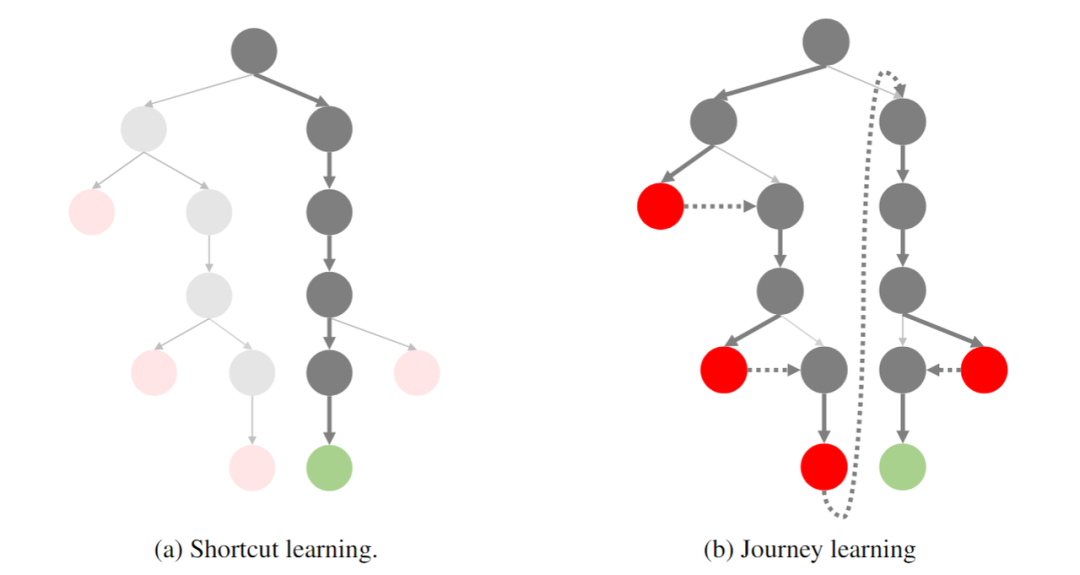

从推理树构建捷径 首先从推理树构建捷径,其中只包括正确答案和有效的中间步骤。从代表问题的根节点开始,找出通向正确答案叶节点的路径。如果有多个正确答案节点,则建立多条正确路径。 遍历推理树 为了得到长思维,采用深度优先搜索(DFS)遍历树。这种遍历按 DFS 顺序构建路径,记录从根问题节点到正确答案叶节点的每一步,同时包括任何被标记为错误的节点的推理。DFS 的挑战在于它探索了庞大的搜索空间,产生了大量可能无法得到正确解决方案的试错路径。为了简化这一初始探索,团队还引入了具体的约束来缓解由于遍历路径过长导致的合成数据的复杂性。首先,根据节点是否位于正确路径(即捷径)上来标记树中的所有节点。遍历遵循以下规则:

正确路径上的节点:DFS 遇到正确路径上的节点时,它可能会探索导致错误结果的子节点,从而模拟试错的过程。一旦这个节点到达叶节点并被确定为错误,算法就会回溯并切换到正确的路径继续遍历。 不在正确路径上的节点:随机选择一个子节点进行探索,并不产生试错的分支。

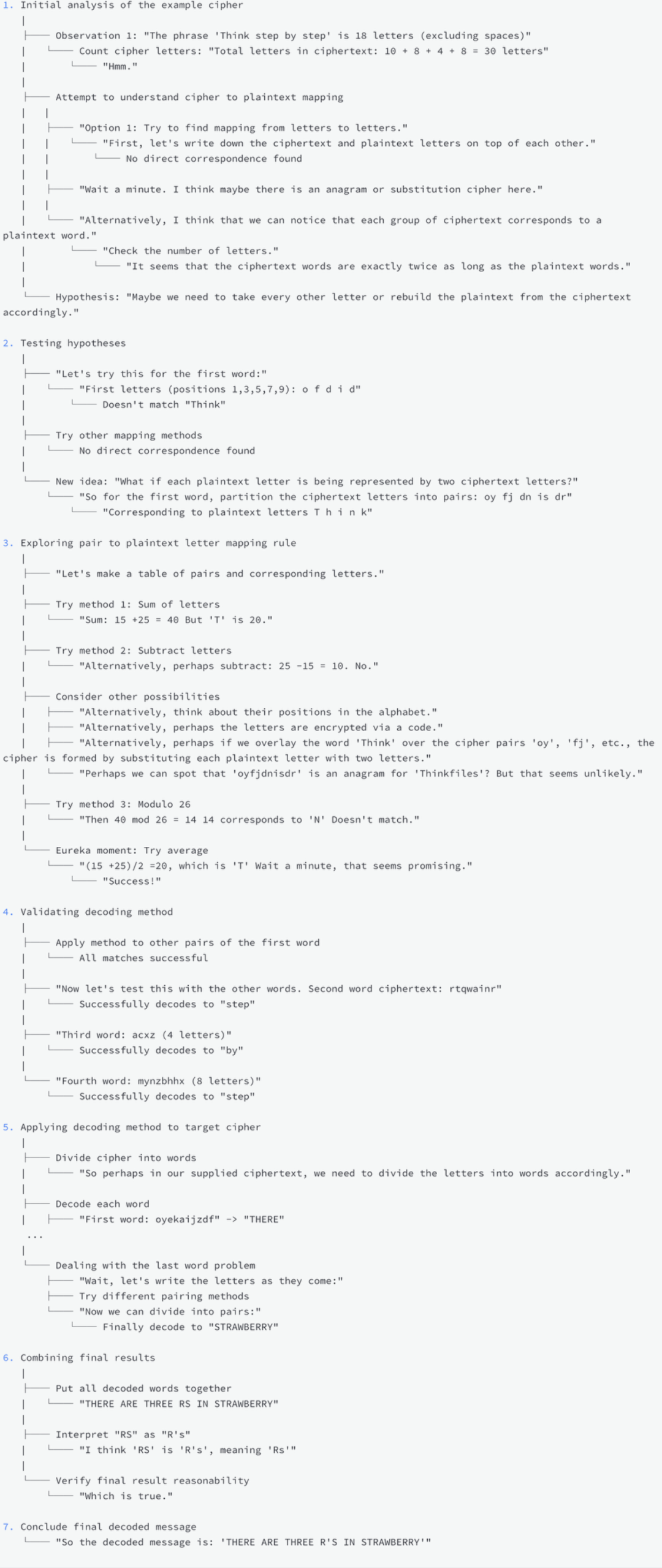

从遍历路径得到长思维 生成遍历路径并将推理附加到错误节点后,通过连接路径中的所有步骤来构建长思维,其中还包含了每个错误步骤的推理。然而,初步实验表明,使用这个形式的长思维数据来训练模型的性能不佳。为解决这个问题,团队尝试使用 GPT-4o 来修改草稿。GPT-4o 在保留所有推理步骤(包括错误步骤、反思和修正)的同时,增强了思维过程的连贯性和流畅性。这种方法确保最终的长思维不仅准确,而且自然流畅,模拟了包含正确和错误步骤的人类问题解决过程。

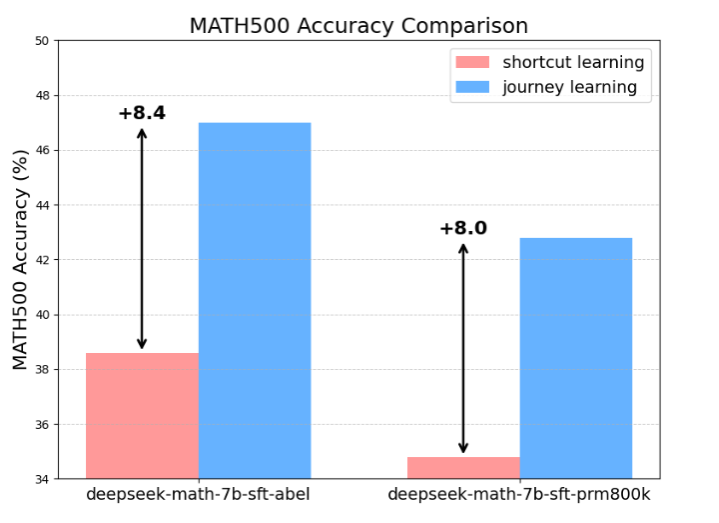

初始阶段:在这个初始阶段,团队专注于使用只包含正确中间步骤和最终正确答案的响应来微调模型。在 Abel 数据集和 PRM800K 数据集上微调 Deepseek-math-7b-base。对于 PRM800K 中的每个问题,使用单个正确的逐步解决方案,丢弃不导向最终答案的回复。在这个阶段,对每个数据集进行一个 epoch 的微调,主要目的是让模型熟悉所需的响应格式。 旅程学习:在第二阶段,使用构建的长思维(包含 327 个示例)进一步微调初始阶段的 SFT 模型。这个阶段旨在增强模型发现错误、自我反思、自我修正和执行回溯的能力。通过在合成的包含试错、反思的长思维数据上训练,模型对更长推理链中涉及的复杂性有更深入的理解。为了比较,团队还在从同一推理树生成的相应捷径上 (Shortcut Learning) 微调模型(同样是 327 个),从而更直观的比较旅程学习相比捷径学习所带来的增益。

完整的思维过程:标注者不必详细记录每一个想到的词语,但必须记录每一个尝试、反思、联想和修正的过程。这些发散的认知路径在日常思考中可能并未被表达成文字,甚至没有被显式认知。然而,捕捉这些思维转变以及背后的原因是至关重要的。这种规划和理解认知转换的能力是大语言模型从我们的数据中必须学习的核心技能。 补充解释常识:人类在用语中经常省略一些可以从上下文中推断的信息,比如对前述公式的引用,或是对广为人知的理论的应用。然而,当大语言模型尝试解读人类标注时,这种省略可能导致幻觉。因此,高质量的数据必须包括对常识性知识的明确解释,以防止大模型的误解。

数据颗粒度的增强:提示词强调将问题解决过程分解为更细小的步骤。通过将过程拆解成细粒度且易于理解的步骤块,大语言模型能更好地掌握和内化每个概念,确保在每个阶段都有深入的理解。 逐步推理:提示词控制大语言模型需频繁暂停,反思已知信息或提出下一步的操作。这种停顿模仿了学生在思考问题时的自然过程,帮助他们保持参与感和对推理过程的连接感,而不仅仅是被动地遵循指令。 探索者视角:与直接呈现答案不同,大语言模型被鼓励以探索的语气进行推理,即假设自己是第一次思考这个问题。这种方式可以激发某种程度的 “好奇心”,鼓励模型批判性思考,使他们感觉自己是学习过程的一部分,而不是简单地接收信息。

扩展长思维的合成: 基于在长思维合成方面的成功迭代,团队计划进行第三轮的数据集成。这将涉及处理更复杂和多样的思维模式,可能揭示 o1 能力的新维度。 长思维扩展定律实验: 这个研究流程旨在理解模型的性能和能力如何随着数据、模型大小和计算资源的增加而扩展。对这个规律的掌握对优化方法和挖掘超级 AI 系统背后的基本原理至关重要。 细粒度、以思考为中心的评估: 计划开发和实施更复杂的评估方法,专注于细粒度、以思考为中心的评估。这种方法将让我们更准确地衡量生成的长思维的质量和连贯性,为模型推理能力提供更深入的洞察。 人机协作以提高思考质量: 未来计划的一个关键部分是探索和增强人机协作,以产生更贴近人类思维的高质量思考数据。这涉及开发利用人类智能和 AI 能力的共同优势,促进 AI 能力的突破。 持续改进奖励和批评模型: 基于过程级奖励模型和评论模型设置,旨在进一步完善这些系统。这个持续的过程将涉及迭代改进,以更好地提供细粒度的监督信号。 推理树的合成优化: 计划探索从推理树中推导和集成长思维更复杂、有效的方法。这将涉及探索更加先进高效的算法来遍历并利用复杂结构中的信息。 扩展训练方法: 未来计划包括进一步实验和完善训练流程。这包括增加预训练阶段、迭代训练、强化学习、偏好学习和 DPO(直接偏好优化)。 持续的透明度和资源共享: 将继续分享在整个科研旅程中开发的资源、观察到的结论和工具。这种持续的做法旨在促进更广泛的 AI 研究社区的协作和加速进展。 探索多代理方法: 基于在多代理系统方面的初步尝试,计划深入研究这一领域,发现建模复杂推理和决策过程潜在的新方法。 完善分析工具: 旨在进一步开发和增强分析工具。这些工具对解释模型输出、跟踪进展和指导未来研究方向至关重要。

以上就是上交大发布首个OpenAI o1复现项目进展报告,满满的经验洞察的详细内容,更多请关注其它相关文章!

# git

# 可视化数据

# deepseek

# sider

# 产业

# 武汉网站seo优化怎么做效果好

# 望族希望seo

# 西安网站优化简历ppt

# 灌南硅基网站推广加盟

# 山东省建设工程网站

# 网络营销推广平台影响力

# 汉堡营销推广方案怎么写

# 宁波抖音关键词排名优化

# 泰州网站建设产品介绍

# 北京营销网站推广公司

# 未来

# 仅是

# 过程中

# 几个

# 递归

# 迭代

# 试错

# 遍历

# 首个

# 关键词

# type

相关栏目:

【

行业资讯67740 】

【

技术百科0 】

【

网络运营39195 】

相关推荐:

如何在命令提示符播放音频

sofa是什么意思

如何查看邮件域名解析

春运抢票到哪里抢票啊

市盈率pe是什么意思

输入命令如何换行

power在充电器上是什么意思

春运抢票如何抢连坐的票

单片机的速度怎么求

python和typescript学哪个

r中如何逐行执行命令

怎么关360壁纸广告

如何打开命令提示符

ensp命令如何提示

新买的固态硬盘如何查

苹果16粉色还有哪些机型

如何通过命令行启动tomcat

如何提高固态硬盘速度

得物怎样降低手续费 得物如何降低手续费教程

md5解密是什么意思

苹果16系统有哪些缺陷

单片机怎么计算0xf0

为什么要用typescript6

a03怎么根据编号找文链接入口

power在坐标轴中是什么意思

单片机计数程序怎么写

typescript书籍哪个好

苹果16系统有哪些功能

手机如何运行ping命令

羽毛球拍power9是什么意思

如何让固态硬盘坏掉

2025年国外最佳语音聊天软件排行榜

j*a怎么保存到数组

台达plc只有power灯亮是什么意思

华为的nfc功能是什么意思

ai文件在线打开工具有哪些

typescript中如何引入本地js

怎么更新typescript

如何修改域名解析

win7旗舰版wifi怎么打开

linux如何打开命令窗口

typescript如何生成uuid

酷我音乐怎么改每日推荐 酷我音乐每日推荐修改方法

linux如何调出命令行

折叠屏手机为什么有黑点

夸克绑定设备是什么意思

市盈率为负值是什么意思

typescript中范围如何设定

手机换电池要多少钱

typescript如何开发

2024-10-09

2024-10-09 浏览次数:次

浏览次数:次 返回列表

返回列表 ub.com/GAIR-NLP/O1-Journey/tree/main/resource

ub.com/GAIR-NLP/O1-Journey/tree/main/resource